Imagina poder rescatar esas imágenes antiguas o de baja calidad que forman parte de tu archivo visual, transformándolas en recursos de alta calidad con solo un toque. GFPGAN (Generative Facial Prior GAN) es una tecnología de restauración de imágenes de vanguardia, que está revolucionando la manera en que las empresas mejoran la calidad visual de sus activos. Este modelo avanzado utiliza redes generativas adversarias (GANs) para tomar fotos deterioradas y mejorar su calidad de manera notable. Funciona como una guía inteligente que le muestra a la computadora cómo reconstruir los detalles más finos de una fotografía conservando la esencia original.

GFOGAN no se limita a hacer retoques superficiales; realmente transforma la imagen sintetizando detalles realistas a partir de una foto borrosa o de baja calidad. Al poner a prueba su red generativa frente a una red discriminadora, que distingue entre lo real y lo generado, logra restauraciones faciales que superan ampliamente los métodos tradicionales, manteniendo un equilibrio perfecto entre la precisión y la autenticidad.

En este artículo, abordaremos cómo GFOGAN está impulsando una transformación significativa en sectores estratégicos y como el impacto de esta tecnología en la restauración y mejora de la calidad de imágenes y como permite a las organizaciones optimizar su presencia digital, fortalecer la experiencia del cliente.

Entendiendo GFPGAN: La tecnología detrás de la restauración de imágenes avanzadas

GFPGAN, o Generative Facial Prior GAN, se posiciona como un modelo de restauración de imágenes avanzado que aprovecha las redes generativas adversarias (GANs) para mejorar significativamente la calidad de imágenes degradadas. Aunque inicialmente enfocado en la restauración facial, su arquitectura flexible permite adaptarse a diversos tipos de imágenes, ofreciendo una solución integral para múltiples necesidades de restauración visual.

Componentes clave y funcionalidades

Redes Pre-entrenadas: Constituyen la base del modelo, proporcionando un marco de referencia sólido sobre la estructura de las imágenes. Estas redes están pre-entrenadas en diversos datasets que pueden abarcar más allá de los rostros, lo que facilita la adaptación de GFPGAN a distintas aplicaciones de restauración, ya sea para documentos, paisajes o incluso arte.

Generador: Actúa como el núcleo creativo del modelo, tomando imágenes dañadas como entrada y generando una versión restaurada de alta calidad. El generador refina los detalles, elimina el ruido y mejora la nitidez de las imágenes a partir del conocimiento adquirido de las redes pre-entrenadas y del proceso de entrenamiento continuo.

Discriminador: Funciona como un evaluador crítico, encargándose de comparar las imágenes generadas con imágenes reales para determinar la calidad de la restauración. Su papel es crucial para asegurar que las imágenes restauradas sean convincentes y realistas.

Priors (conocimientos previos): Extienden su aplicación más allá de los rostros, abarcando estructuras de objetos, texturas y otros elementos visuales relevantes. Estos priors permiten que GFPGAN adapte sus capacidades para restaurar diferentes tipos de imágenes, como pinturas o paisajes, integrando conocimientos específicos del dominio para una restauración más precisa.

¿Qué son los facial priors?

Imagina los fácil priors son un conjunto de reglas o plantillas que describen cómo debería ser un rostro humano. Estas reglas incluyen información sobre:

- Estructura ósea: La posición y forma de los huesos del cráneo, que determinan la forma general del rostro.

- Puntos de referencia facial: Puntos clave como los ojos, la nariz, la boca y las cejas, y sus relaciones espaciales.

- Distribución de texturas: La forma en que la piel, el cabello y otros elementos faciales se distribuyen en el rostro.

- Expresiones faciales: Cómo cambian los rasgos faciales cuando una persona expresa diferentes emociones.

¿Cómo mejoran los facial priors la restauración de detalles finos?

Consistencia anatómica: Al conocer la estructura ósea subyacente, el modelo puede garantizar que los rasgos faciales reconstruidos sean anatómicamente correctos. Por ejemplo, si se restaura un ojo, el modelo asegurará que esté ubicado en la posición correcta en relación con la nariz y las cejas, y que tenga la forma y el tamaño adecuados.

Priorización de detalles: Los priors permiten al modelo priorizar la restauración de ciertos detalles, como las arrugas, las pecas o las líneas de expresión. Esto se logra asignando mayor importancia a estas características durante el proceso de generación.

Generación de detalles realistas: Al conocer la distribución típica de las texturas faciales, el modelo puede generar detalles realistas, como la textura de la piel o el brillo de los ojos.

Preservación de la identidad: Los priors ayudan a preservar la identidad del sujeto al garantizar que los rasgos faciales distintivos se mantengan durante el proceso de restauración.

¿Cómo se implementan los facial priors?

Los facial priors se pueden implementar de varias maneras:

- Mapas de calor: Se pueden crear mapas de calor que indiquen la probabilidad de que un píxel en particular pertenezca a una característica facial específica (por ejemplo, un ojo, una nariz).

- Redes neuronales: Se entrenan redes neuronales para predecir la ubicación de los puntos de referencia faciales en una imagen.

- Modelos 3D: Utiliza modelos 3D de rostros para generar priors que capturen la variabilidad de la forma facial.

Flujo de trabajo del modelo

Entrada

Procesamiento: La imagen de entrada, ya sea una fotografía dañada, una pintura deteriorada o cualquier otro tipo de imagen de baja calidad, se somete a preprocesamiento. Este puede incluir la conversión a un formato específico, la normalización de los valores píxeles o la eliminación de ruido inicial.

Escalado: La imagen se ajusta a una resolución óptima para maximizar la eficiencia del modelo y la calidad de la restauración, equilibrando precisión y rendimiento.

Generación

Decodificación: El generador utiliza una red neuronal para decodificar la imagen de entrada. Esto implica convertir la representación numérica de la imagen en una representación de mayor nivel, que capture las características más importantes de la imagen.

Síntesis: Basándose en los priors y en el conocimiento adquirido durante el entrenamiento, el generador sintetiza una nueva imagen. Esta nueva imagen es una versión restaurada de la imagen de entrada, con los detalles faltantes rellenados y el ruido reducido.

Modulación por priors: Los priors guían al generador, asegurando que la imagen restaurada sea consistente con el conocimiento previo sobre el tipo de imagen que se está restaurando. Por ejemplo, si se está restaurando un rostro, los priors garantizarán que los ojos, la nariz y la boca estén ubicados en las posiciones correctas y tengan una apariencia realista.

Discriminación

Comparación: El discriminador evalúa la imagen generada en comparación con una base de datos de imágenes auténticas. Esta evaluación no solo se realiza a nivel de píxeles, sino también considerando características abstractas como la textura, forma y detalles estructurales.

Clasificación: Se asigna una puntuación a la imagen generada, indicando su grado de realismo. Una puntuación alta implica que la imagen es prácticamente indistinguible de una imagen real, validando la eficacia del generador.

Retroalimentación

Cálculo de la pérdida: Se mide la diferencia entre la puntuación asignada por el discriminador y la puntuación objetivo, lo que proporciona una métrica de la calidad de la restauración y se utiliza para calcular una función de pérdida.

Propagación hacia atrás: La pérdida calculada se propaga a través del modelo, permitiendo ajustar los parámetros del generador. Esto mejora su capacidad para producir imágenes más precisas y realistas.

Optimización continua

Iteraciones: El ciclo de generación, discriminación y retroalimentación se repite múltiples veces. Cada iteración refina las capacidades del generador y hace que el discriminador sea más riguroso.

Convergencia: El proceso de entrenamiento continúa hasta que el generador y el discriminador alcanzan un equilibrio óptimo, donde el generador produce imágenes que son indistinguibles de las imágenes reales, asegurando la máxima calidad en la restauración.

Evolución de la restauración de imágenes: De las técnicas tradicionales a GFPGAN

La restauración de imágenes ha evolucionado significativamente desde los enfoques tradicionales hacia métodos más sofisticados basados en inteligencia artificial. Históricamente, técnicas como la interpolación de píxeles y la «super-resolution» han sido utilizadas para mejorar la calidad visual. Sin embargo, estas metodologías presentan limitaciones que los modelos basados en redes generativas adversarias (GANs), como GFPGAN, han logrado superar, proporcionando soluciones más avanzadas y efectivas para la industria.

Limitaciones de los enfoques tradicionales

Interpolación de Píxeles: Consiste en incrementar la resolución de una imagen mediante la adición de píxeles entre los existentes. Aunque simple en implementación, este método genera imágenes que carecen de detalles finos y suelen ser borrosas, limitando su utilidad en aplicaciones empresariales que requieren alta calidad visual.

Super-Resolution: Utiliza algoritmos que intentan recuperar detalles perdidos en imágenes de baja resolución. Si bien puede ofrecer mejoras visuales, a menudo resulta en imágenes con artefactos artificiales, sin capturar adecuadamente la complejidad de texturas y estructuras finas, lo que no satisface las exigencias de sectores como la restauración de documentos históricos o la mejora de contenidos multimedia.

Ventajas competitivas de GFPGAN (Basado en GANs)

Generación de detalles realistas: GFPGAN aprovecha las capacidades de las GANs para aprender patrones complejos en los datos, permitiendo generar detalles que no estaban presentes en la imagen original.

Preservación de la estructura original: A diferencia de los métodos tradicionales, GFPGAN conserva la estructura general de la imagen al restaurar detalles perdidos. Las GANs logran esto a través de la representación latente, que captura las características más relevantes del contenido, lo cual es esencial para aplicaciones que requieren la preservación de la integridad visual.

Adaptabilidad a diversos tipos de imágenes: La arquitectura flexible de GFPGAN permite entrenar el modelo en una amplia variedad de imágenes, desde fotografías hasta documentos y obras de arte. Esta versatilidad lo convierte en una opción ideal para sectores con diferentes necesidades de restauración visual.

Mejora continua a través del aprendizaje iterativo: Gracias a su naturaleza iterativa, GFPGAN optimiza su rendimiento con cada ciclo de entrenamiento, mejorando su capacidad para restaurar imágenes a medida que se le proporcionan más datos, lo cual incrementa su precisión y aplicabilidad en entornos corporativos que buscan soluciones escalables y eficientes.

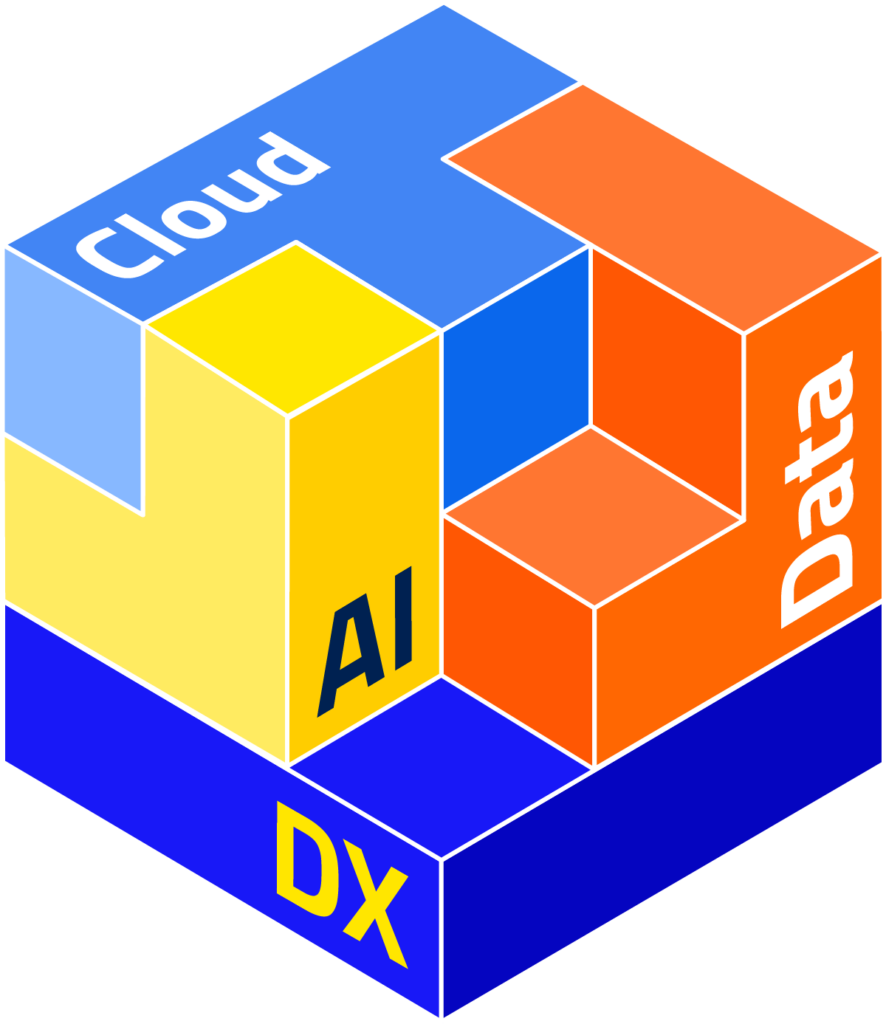

Influencia de GFPGAN para una plataforma de visión artificial como OS Visión

Os Visión es un plataforma que actúa como una fábrica de modelos la cual optimiza la creación, implementación y gestión de aplicaciones de visión artificial a gran escala. La solución incluye flujos de trabajo automatizados y modelos avanzados, como YOLO que permiten ofrecer alertas y respuestas en tiempo real para maximizar la eficiencia operativa de los clientes.

Nuestra plataforma integrada con API facilita la conexión directa con los sistemas existentes de los usuarios, eliminando la necesidad de desarrollar aplicaciones adicionales. Además implementamos redes neuronales especializadas para garantizar la privacidad con los requisitos específicos de cada industria.

Transformando la visualización: El rol de GFPGAN en visión artificial

A continuación, te presentamos algunos ejemplos de cómo este innovador modelo está marcando la diferencia en plataformas de visión artificial:

Optimización de la calidad de imagen: GFPGAN puede utilizarse para elevar la calidad de imágenes capturadas o procesadas por OS Vision, especialmente en situaciones donde las imágenes originales presentan baja resolución, desenfoque o degradación

Restauración avanzada: Para proyectos que involucren imágenes históricas o dañadas, GFPGAN ofrece la capacidad de reconstruir características visuales, lo cual incrementa la precisión en aplicaciones de análisis o reconocimiento de imágenes.

Expansión de datos para entrenamiento: La tecnología facilita la generación de variaciones realistas de imágenes, incrementando así el volumen y la diversidad de los conjuntos de datos de entrenamiento, lo que podría mejorar el rendimiento de los modelos de reconocimiento de OS Vision.

Mejora en la identificación visual: Al proporcionar imágenes más nítidas y detalladas, GFPGAN contribuye a la precisión de los algoritmos de identificación.

Corrección de poses y normalización de patrones visuales: La capacidad de ajustar poses o normalizar patrones en las imágenes facilita los procesos de comparación y análisis, mejorando la consistencia en las aplicaciones de reconocimiento.

Nuevas fronteras con GFPGAN: Aplicaciones innovadoras y avanzadas

Restauración de video en tiempo real

GFPGAN ofrece una ventaja competitiva en el sector empresarial al transformar la manera en que se manejan las secuencias de video en tiempo real, abriendo nuevas posibilidades para la mejora visual en diversas industrias.

Procesamiento optimizado para entornos exigentes: La restauración de video en tiempo real requiere que el modelo procese cada fotograma con velocidad y precisión. Para satisfacer las demandas del entorno empresarial, se implementan aceleradores de hardware como GPUs de alto rendimiento y algoritmos avanzados que optimizan la eficiencia del procesamiento.

Consistencia visual para resultados de calidad: En aplicaciones empresariales, la calidad visual no puede comprometerse. GFPGAN asegura que la restauración mantenga una consistencia uniforme a lo largo de toda la secuencia, utilizando técnicas que integran datos de fotogramas anteriores y posteriores para ofrecer una mejora visual estable y profesional.

Adaptación en tiempo real a condiciones cambiantes: La capacidad de GFPGAN de ajustar sus parámetros automáticamente frente a cambios en la iluminación o movimientos bruscos es crucial para sectores como el monitoreo de seguridad, transmisión de eventos en vivo, o experiencias inmersivas de realidad aumentada, donde la calidad de imagen debe ser óptima en todo momento.

Aplicaciones empresariales clave

Restauración y archivado de videos corporativos antiguos: Recuperación de material audiovisual valioso para iniciativas de branding o históricos.

Optimización de la calidad en transmisiones en vivo: Mejora de la experiencia del usuario en eventos corporativos, conferencias y webinars.

Realidad aumentada y virtual para entrenamientos y simulaciones: Creación de entornos visuales más realistas para programas de capacitación empresarial o simulaciones operativas.

Aplicaciones en el mundo de las imágenes médicas

GFPGAN también puede hacer una gran diferencia en el campo de la salud, ayudando a que los médicos vean lo que realmente importa en las imágenes.

Adaptación personalizada: Cada tipo de imagen médica, ya sea una resonancia, tomografía o radiografía, tiene sus propios retos. Por eso, GFPGAN se ajusta para mejorar cada modalidad según sus necesidades específicas.

Manteniendo lo importante: La restauración se realiza con mucho cuidado para no alterar las características que son críticas para el diagnóstico médico.

Colaboración con expertos: Los resultados se validan junto a médicos para garantizar que sean útiles y precisos.

Usos prácticos

- Mejor visibilidad: Realza los detalles más sutiles de las imágenes, ayudando en diagnósticos complejos.

- Eliminación de ruido: Reduce las imperfecciones en las imágenes para que se vean más claras.

- Más resolución, más detalles: Permite ver detalles que podrían pasarse por alto con imágenes de baja resolución.

Expansión a otros tipos de imágenes

GFPGAN no se queda solo en rostros, sino que puede aplicarse a muchos otros tipos de imágenes para mejorar su calidad.

Nuevos “Priors” para diferentes imágenes: Para restaurar distintos tipos de objetos o escenas, GFPGAN utiliza nuevas referencias visuales que representan mejor el contenido.

Reentrenamiento para nuevos usos: Se entrena el modelo con conjuntos de datos específicos según el nuevo dominio, como paisajes, arte o incluso imágenes satelitales.

Ajustes en la arquitectura: A veces, hay que hacer ajustes especiales al modelo para obtener los mejores resultados en distintos tipos de imágenes.

Dónde se aplica:

- Restauración de arte: Mejora la calidad de pinturas y otras obras de arte que han sufrido con el tiempo.

- Imágenes Satelitales de alta Calidad: Aumenta la nitidez y el detalle de las imágenes tomadas desde el espacio.

- Fotos Históricas que reviven: Restaura imágenes antiguas, recuperando detalles que parecían perdidos para siempre.

Preparando el terreno: Qué necesitas en hardware y software

Requisitos de hardware

GPU: Es fundamental contar con una tarjeta gráfica potente, como NVIDIA GeForce RTX o AMD Radeon, para acelerar tanto el entrenamiento como la inferencia del modelo.

CPU: Un procesador multi-core con alta frecuencia de reloj es necesario para tareas intensivas en la gestión de datos y preprocesamiento.

Memoria RAM: Se recomienda un mínimo de 16GB de RAM para gestionar modelos y conjuntos de datos voluminosos.

Almacenamiento: Un SSD de alta velocidad es ideal para el almacenamiento de datos de entrenamiento y modelos.

Requisitos de software

Framework de Deep Learning: PyTorch y TensorFlow son los frameworks preferidos para la implementación de GFPGAN.

Entorno de Desarrollo (IDE): Herramientas como PyCharm o Visual Studio Code facilitan la escritura y depuración del código.

Bibliotecas Adicionales: Es posible que se requieran bibliotecas para el preprocesamiento de imágenes, visualización y otras tareas complementarias.

Optimización del rendimiento

Cuantización: Reducir la precisión de los pesos del modelo para optimizar el tamaño y la velocidad de inferencia.

Poda: Simplificar el modelo eliminando conexiones superfluas para reducir la complejidad.

Ajuste de hiperparámetros: Optimizar los parámetros del modelo para maximizar la precisión y eficiencia.

Uso de hardware acelerado: Implementar GPUs y TPUs para mejorar el rendimiento en el entrenamiento y la inferencia.

Paralelización: Distribuir el procesamiento entre múltiples núcleos de la CPU o GPU para acelerar las operaciones.

Escalabilidad y adaptación en producción

Para desplegar GFPGAN en entornos de producción a gran escala, se deben considerar los siguientes aspectos:

Arquitectura de microservicios: Modularizar la aplicación en componentes más pequeños y escalables.

Contenedores: Utilizar tecnologías como Docker para encapsular la aplicación y sus dependencias.

Orquestación: Implementar herramientas de orquestación como Kubernetes para gestionar y escalar los contenedores.

Despliegue en la nube: Aprovechar la infraestructura en la nube para acceder a recursos escalables y garantizar alta disponibilidad.

Procesamiento distribuido: Implementar técnicas de procesamiento distribuido para mejorar la escalabilidad y el rendimiento general del sistema.

Reflexión

La evolución de las arquitecturas de las Generative Adversarial Networks (GANs) está llevando la calidad visual a nuevas alturas, y la evolución de las arquitecturas de las GANs es una prueba palpable de ello. GFPGAN se presenta como una herramienta poderosa que transforma imágenes pixeladas y deterioradas en representaciones de alta calidad. Este avance no solo mejora la calidad visual, sino que también ofrece un nuevo paradigma en la forma en que interactuamos con el contenido digital. En plataformas como OS Vision, este modelo demuestra su capacidad para llevar la claridad a un nuevo nivel, elevando la experiencia del usuario.

Reflexionando sobre su aplicación en diversas industrias, es curioso considerar cómo esta tecnología puede optimizar procesos y enriquecer la experiencia del cliente. La capacidad de restaurar detalles visuales con precisión puede influir significativamente en la percepción del cliente y la calidad de la presentación de productos y servicios.

Si estás interesado en comprender mejor el impacto que esta tecnología puede tener en tu empresa, te animamos a explorar más sobre nuestras soluciones. Hablar con nuestro equipo te permitirá descubrir cómo implementar estas innovaciones puede transformar tu negocio, abriendo nuevas oportunidades y mejorando la efectividad en un entorno digital en constante evolución.