Hace pocos días Ultralytics volvió a sorprendernos con un gran anuncio. Nos presentó su nuevo modelo YOLO11 en un evento espectacular donde se destacaron avances impresionantes en tecnologías como la visión por computadora y el machine learning. Esta nueva versión no solo marca una evaluación, sino que redefine lo que se puede lograr con el campo de la visión artificial.

YOLO11 es el resultado de la colaboración entre expertos en IA, innovadores y desarrolladores, y está diseñado para llevar las capacidades de la visión artificial a nuevos horizontes. Con una serie de innovaciones técnicas, este modelo es más rápido, preciso y versátil, posicionándose como una herramienta fundamental tanto para desarrolladores como para investigadores.

Su arquitectura lo convierte en la solución ideal para tareas diversas de visión artificial, desde la detección de objetos en tiempo real hasta la clasificación. Entre las mejoras clave se incluyen una extracción de características mejorada, mayor precisión con menos parámetros y velocidades de procesamiento más rápidas, En este artículo te contaremos cómo YOLO11 eleva significativamente el rendimiento en tiempo real y abre nuevas posibilidades para aplicaciones avanzadas.

¿Por qué YOLO11 en lugar de YOLOv11?

No lo sé, pero esta es la respuesta que obtuve por parte de Muhammad Rizwan Munawar de Ultralytics, así que tendremos que descubrirlo

Características principales de YOLO11: Velocidad y precisión en visión artificial

La nueva joya de la familia Ultralytics, mejora todo lo que hemos visto en las versiones anteriores para ofrecer precisión y velocidad sin precedentes. Este modelo se destaca por sus mejoras arquitectónicas y avances en los métodos de entrenamiento, lo que lo convierte en una opción potente para diversas aplicaciones de visión artificial.

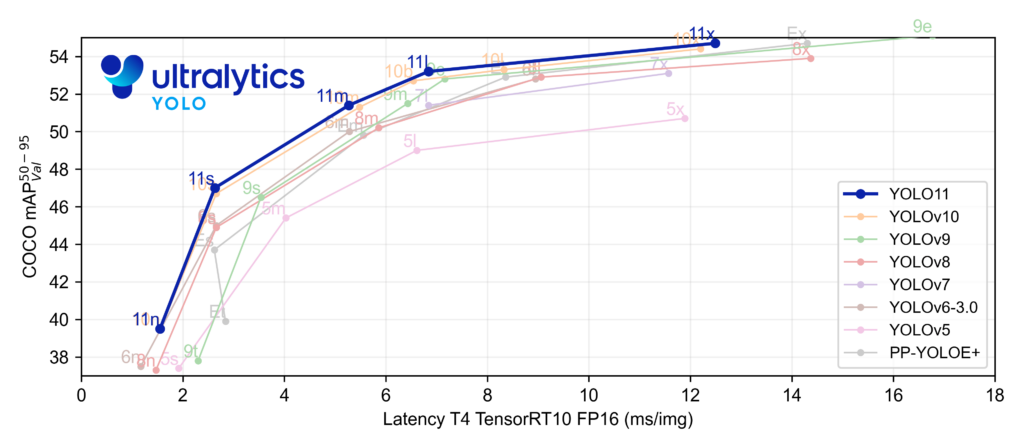

Cómo se comporta YOLO11 con el dataset COCO

El dataset Common Objects in COntext (COCO) es el dataset más común en el que se basan todos los modelos de detección de objetos para compararse y medir el performance, comparándose entre ellos usando la métrica más popular en la detección de objetos: mean Average Precision (mAP), que aprovecha al máximo la precisión y la sensibilidad del modelo.

En este contexto, YOLO11 se destaca como un avance significativo en la tecnología de detección de objetos. Gracias a su arquitectura innovadora y a sus mejoras en el entrenamiento y la optimización, YOLO11 supera a todos sus predecesores y establece un nuevo estado del arte en la detección de objetos. Esto se refleja en su puntaje mAP, que es utilizado como referencia para comparar el desempeño de diferentes modelos. En este sentido, YOLO11 alcanza un mAP de 39.5 en su versión nano (YOLO11n), mientras que la versión Extra Large (YOLO11x) consigue un mAP de 54.7.

Características destacadas de YOLO11

Extracción de características avanzada: YOLO11 viene con una arquitectura renovada, lo que significa que puede captar los detalles más finos de las imágenes de manera mucho más eficiente. Esta mejora permite que el modelo detecte objetos con mayor precisión, incluso en situaciones complejas o entornos difíciles.

Optimización para velocidad y eficiencia: Con sus diseños arquitectónicos y canales de entrenamiento más eficientes, YOLO11 es mucho más rápido que sus predecesores. La mejora en su velocidad de procesamiento se logra sin sacrificar precisión, logrando un balance perfecto entre rendimiento y rapidez.

Mejora precisión con menos recursos: Una de las mejoras más impresionantes de YOLO11 es una capacidad de ofrecer una mayor precisión (mAP) utilizando menos de parámetros que YOLOv8. Esto significa qué, además de ser más preciso, YOLO11 es también más eficiente en términos de uso de recursos, sin perder rendimiento.

Versatilidad en distintos entornos: Ya sea que se utilice en dispositivos Edge, plataformas en la nube o sistemas con GPU NVIDIA, YOLO11 se adapta a cualquier entorno. Esta flexibilidad permite su integración y uso en una variedad de aplicaciones, desde proyectos pequeños hasta soluciones a gran escala.

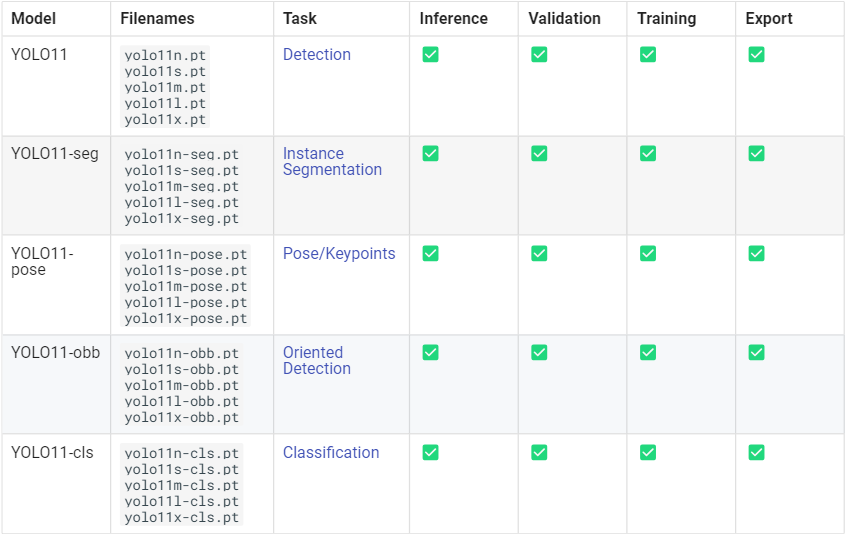

Amplitud de tareas soportadas: Desde detección de objetos en tiempo real hasta tareas más complejas como segmentación de instancias, clasificación de imágenes, pose estimation o oriented bounding boxes (OBB), YOLO11 puede abordar una gran variedad de problemas de visión artificial, lo que lo convierte en una herramienta ideal tanto para desarrolladores como para investigadores.

YOLO11 no solo mejora lo que ya está bien, sino que abre nuevas posibilidades al llevar capacidades de la visión artificial a otro nivel. Su diseño avanzado y flexibilidad en distintos entornos lo hacen ideal para proyectos de todo tipo.

Maximiza el potencial de YOLO11 y domina las funcionalidades clave

Ultralytics YOLO11 no es simplemente un modelo más de detección de objetos, es un ecosistema completo que cubre todo el ciclo de vida del aprendizaje automático. Desde la ingesta de datos hasta la implementación y el seguimiento en tiempo real, YOLO11 ofrece una gama de modos diseñados para brindarte flexibilidad y eficiencia en cada fase de tu proyecto.

Modos principales de YOLO11

Modo de entrenamiento: Permite ajustar el modelo a conjuntos de datos personalizados, optimizando parámetros para lograr predicciones precisas. Ideal para mejorar el rendimiento en escenarios específicos.

Modo de validación: Evalúa el modelo post-entrenamiento para medir precisión y generalización. Perfecto para realizar ajustes finos.

Modo de predicción: Utiliza modelos entrenados para hacer inferencias en datos del mundo real, ya sea en imágenes o videos.

Modo de exportación: Convierte modelos para su uso en entornos de producción, adaptándose a diferentes plataformas y dispositivos.

Modo de tracking: Proporciona capacidades de seguimiento de objetos en tiempo real, ideal para aplicaciones como vigilancia o vehículos autónomos.

Modo de evaluación comparativa: Analiza velocidad y precisión de diferentes formatos de exportación, ayudándote a seleccionar el más eficiente para tu caso de uso.

Entrena, válida, predice y exporta fácilmente

- Entrenamiento: Ajusta tu modelo utilizando datos y parámetros específicos. Optimiza la capacidad del modelo para identificar y localizar objetos con alta precisión.

- Validación: Verifica el rendimiento de tu modelo tras el entrenamiento para asegurar que mantiene un buen nivel de generalización y precisión.

- Predicción: Realiza predicciones en tiempo real o en nuevos conjuntos de imágenes y videos utilizando un modelo entrenado.

- Exportación: Prepara tu modelo para su implementación en múltiples formatos, asegurando que esté listo para ser utilizado en diferentes sistemas o dispositivos.

Predicción sobre videos, imágenes o cámaras mediante YOLO11

Al momento de escribir este artículo y siempre bajo mi opinión, Ultralytics es el framework de visión por computadora más versátil y útil, ya que ofrece una forma accesible y eficiente de realizar inferencia o entrenamiento de redes neuronales con solo unas pocas líneas de código. Esto hace que sea una herramienta invaluable para cualquier profesional o investigador que necesite trabajar con visión por computadora.

A continuación, te mostraremos cómo aprovechar el potencial de YOLO11 para realizar inferencia sobre diferentes fuentes de datos, con solo unos pasos sencillos:

Python 🐍

```python

from ultralytics import YOLO

# Load a model

model = YOLOv10('yolo11x.pt') # load an official model

# Predict with the model

model.predict(0) # predict on your webcam

model.predict(“video.mp4”) # predict on video

model.predict(“rtsp://user:password@ipcamera:portcamera”) # predict on rtsp camera

model.predict(“image.jpg”) # predict on image

```CLI 🤓

```bash

yolo predict detect model=yolo11x.pt source=video.mp4 show=True save=True

```Resultados y Comparativa de YOLO11 frente a otros modelos YOLO

Es asombroso lo rápido que ha avanzado el modelo YOLO desde el lanzamiento de YOLOv5 por parte de Ultralytics. Las diferencias entre las últimas cuatro versiones (YOLOv8 a YOLOv11) son casi imperceptibles, lo que demuestra el impresionante desarrollo y evolución continua en la detección de objetos beneficiando a miles de personas y democratizando este tipo de soluciones que llegan a todo el que se lo proponga.

Tareas y modos admitidos en YOLO11

A continuación te presentamos está tabla donde resalta las versiones del modelo y su compatibilidad con los modos de inferencia, validación y exportación, mostrando su capacidad para abordar cualquier tarea de visión artificial que necesites, desde detección básica hasta segmentación y clasificación avanzada.

Capacidades que YOLO11 hace posibles

Este modelo está diseñado para abordar una amplia gama de tareas, brindando soporte avanzado para diversas aplicaciones. Algunas de las principales funciones que ofrece son:

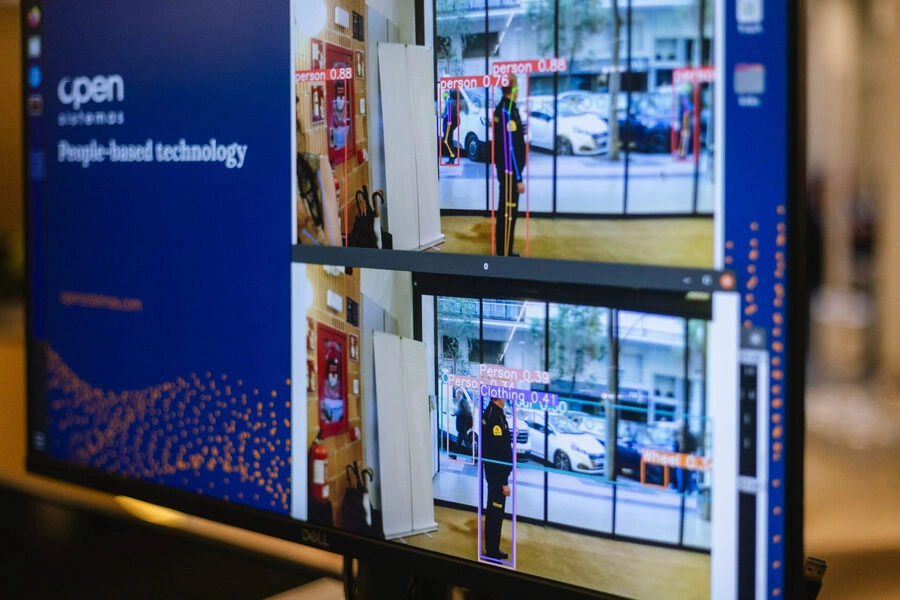

Detección de objetos: Localiza y resalta objetos en imágenes o videos mediante cuadros delimitadores, lo que es esencial para aplicaciones como la seguridad, vehículos autónomos y análisis en comercios.

Segmentación de instancias: Aísla y distingue objetos individuales a nivel de píxel, ideal para áreas como imagenología médica y el control de calidad en procesos de fabricación

Clasificación de imágenes: Asigna imágenes completas a categorías específicas, siendo una excelente herramienta para la organización de productos en e-commerce o para monitorear especies en estudios de vida silvestre.

Pose estimation: Identifica puntos clave dentro de imágenes o videos para rastrear movimientos y posturas, lo que resulta útil en análisis deportivo, seguimiento de la actividad física y aplicaciones en salud.

Oriented Bounding Boxes (OBB): Detecta objetos con ángulos específicos, una función valiosa para tareas de robótica, análisis de imágenes aéreas y automatización en almacenes.

Seguimiento de objetos: Permite monitorear el movimiento de objetos a lo largo de varios fotogramas en tiempo real, siendo fundamental en aplicaciones de seguridad y control de tráfico.

Reflexión

Los modelos YOLO siguen impresionando, y mientras YOLOv10 ya dejó su huella, YOLO11 se consolida como uno de los más avanzados en visión por computadora. Actualmente, su desarrollo se enfoca en mejorar tanto la precisión como la velocidad de procesamiento, lo que lo hace aún más eficiente en aplicaciones en tiempo real. Con avances clave en la detección de objetos en condiciones difíciles, YOLO11 está abriendo nuevas oportunidades en áreas como seguridad, automatización industrial y conducción autónoma, donde la rapidez y la precisión son esenciales.

Si estás interesado en conocer cómo YOLO11 y la tecnología de visión por computadora están transformando diversas industrias, te invitamos a hablar con nuestro equipo. Descubre cómo estas innovaciones pueden ayudarte a mejorar la eficiencia, velocidad y seguridad en tu sector, y cómo OpenSistemas lidera esta transformación tecnológica.